זיוף עמוק

המונח Deepfake (בעברית ״זיוף עמוק״) הוא חיבור של Deep learning עם Fake, כלומר חיבור בין מנועי בינה מלאכותית עם למידה עמוקה לשם יצירת זיוף למשהו, או מישהו קיים. בימים טרופים אלה, בהם יש חשיבות עצומה למידע התקשורתי אותו אנו צורכים, בחרתי להרחיב במאמר זה על המונח ״זיוף אמיתי״, הטכנולוגיה, הסיכונים ודרכי ההתמודדות איתו.

הכוונה ב״זיוף עמוק״ היא לשימוש בבינה מלאכותית ליצירת סרטונים, קטעי סאונד, או תמונות במידה שאינה מאפשרת לזהות את הזיוף. את המונח הזכרתי במאמרי על בינה מלאכותית. טכנולוגיה כזו מאפשרת למשל, הדבקת פנים על וידאו קיים, שימוש בקול של מישהו כדי ״להקריא״ או לומר מלל מסויים, המרת תמונה של אדם לוידאו שלו מדבר, עריכת פרטי פנים וגוף ועוד.

הטכנולוגיה מאפשרת שימושים חיוביים רבים בתחומי הבידור והפנאי, החינוך והרפואה – אך לצידם ישנם שימושים זדוניים למטרת הונאה, סחיטה ומניפולציה על דעת קהל, הונאה פוליטית ופגיעה בביטחון לאומי.

שורשי הזיוף העמוק

שורשי מהפיכת הזיוף העמוק נעוצים במהפכת הלמידה העמוקה שהחלה לפני פחות מעשור. למידה עמוקה משמעותה למידת מכונה מבוססת על רשת נוירונים מלאכותית – כלומר, רשת אלגוריתמים השואבים השראה מאופן הפעולה של רשת העצבים במוח האנושי. הרשת לומדת ומבצעת תיקונים קטנים בזמן אמת על פי מידע המנותח על ידיה, וכך היא מייצרת תוצאות מדויקות יותר ויותר. השימוש במערכות למידה עמוקה נוכח במכשירים חכמים שונים שכולנו משתמשים בהם. רשתות נוירונים מלאכותיות מאפשרות לנו פעולות מוכרות מחיי היומיום שלנו כמו – זיהוי פנים, זיהוי עצמים שונים בתמונות וסרטונים, תמלול, תרגום, שליטה מרחוק במיני מכשירים ועוד.

הזיוף העמוק הנפוץ ביותר הוא בתחום הוידאו, והוא מבוסס על ״החלפת פנים״ או ״החלפת גוף״ של אדם אחד באדם אחר. רשת הלמידה העמוקה מעבדת את תמונת הפנים לדוגמא, ומפענחת את הנתונים המייצגים את הפנים באופן שיאפשר ״לשחזר״ אותן מחדש. זיוף כזה מבוסס ברובו על רשת בשם ״אוטואנקודר״, והיא הנפוצה והזולה יותר בקרב תוכנות חינמיות שונות (או כאלו שבעלות נמוכה) ותוצאותיה אמינות יחסית.

מערכת מתוחכמת יותר בתחום זה נקראת GANs (ראשי תיבות של Generative Adversarial Nets – רשתות יריבות של בינה מלאכותית), והיא מאמנת במקביל שתי רשתות בינה מלאכותית לנתח ולזהות דפוסים של פנים או תנועה במידה שתאפשר ״ליצור״ פנים אנושיות אמינות באופן מלאכותי. את אחת הרשתות מאמנים לחפש ״חריגות״ כדי שהיא תוכל לזהות ״זיופים״ על ידי חיבור שלה לרשת הראשונה ובמקביל – לתמונות וסרטונים אמיתיים. ככל שהרשת השניה תלמד להבחין בזיופים, הרשת הראשונה תלמד ״לזייף״ טוב יותר עד לרמה של ״זיוף עמוק״ שאינו מזוהה בקלות. מערכת זו דורשת משאבים רבים יותר ולכן כרגע היא נפוצה יותר ביצירת תמונות, אך צפוי שהיא תשתפר ותאפשר יצירת סרטונים בעתיד הלא רחוק. הסיכון האמיתי בה נובע מכך שהיא מבוססת על מה שנקרא ״לימוד לא מפוקח״ בו אין צורך בהתערבות אדם.

שימושים בזיוף עמוק

השימושים החיוביים, כאמור, נפוצים בתחום הבידור, הרפואה והחינוך. במאמרי על בינה מלאכותית הזכרתי כלים ליצירת קריינות סינטטית שנשמעת טבעית, הדבקת ״דיבוב״ לתמונה, והחלפת פרצופים או תנועה.

הנה דוגמא ל״העתקת תנועה״ בעזרת מנוע שכזה:

משחקי מחשב יכולים לצמצם עלויות הפקה בעזרת זיוף עמוק כך ששחקן עליו מבוססת דמות יוכל להגיע לצילומים מועטים יחסית, וניתן יהיה להתאים את תנועותיו וקולו למגוון רחב של פעולות שתעשה הדמות המבוססת עליו.

דוגמאות נוספות לשימושים חיוביים בטכנולוגיה בתחום הקולנוע והטלוויזיה –

- צביעה מחדש של סרטוני ארכיון בשחור לבן.

- שיפור איכות וידאו או סאונד מוקלט.

- ״דיבוב״ רב־לשוני המבוסס על ניתוח קולו ותנועות שפתיו של הדובר ולאחר התאמתם להברות בשפה אחרת, תוך שמירה על קולו וצורת דיבורו.

בהקשר זה אציין את מוזיאון דאלי בפלורידה שהשתמש בטכנולוגית זיוף עמוק בכדי לאפשר למבקשרים בתערוכה ״לתקשר״ עם סלבדור דאלי באופן די אמין.

הנה סרטון המציג את סלבדור דאלי ״מלווה״ את הבאים למוזיאון:

בתחום הרפואה השימושים שהזכרתי יכולים לעזור למשל, בניתוח משופר יותר של צילומים ובדיקות שיאפשר זיהוי גידולים שונים מהר יותר, או בכלים שיאפשרו לאנשים עם ליקויים שונים לתקשר טוב יותר בעזרת כלי בינה מלאכותית.

בתחום החינוך הטכנולוגיה מאפשרת למשל, יצירת דמויות היסטוריות ש״יתקשרו״ עם תלמידים. זו דרך מתוחכמת להנגיש לתלמידים נושאים פחות פופולריים באופן שיגרום להם להחרט בזיכרון.

הסכנות בזיוף עמוק

הזיוף העמוק נוצל בשנים האחרונות גם למטרות שליליות שונות כמו הונאה, סחיטה, הפחדה, השחרת דמויות שונות וניסיונות להשפיע על דעת קהל.

חלק מהטכנולוגיות זמינות לקהל הרחב ואינן מצריכות עבודה מרובה – עובדה המנגישה אותן גם לגורמים שליליים.

כך למשל התבצעה גניבה של 243000 דולר מחברת אנרגיה באנגליה כבר ב-2019. מנכ״ל החברה קיבל שיחה מאדם שנשמע כמו המנהל שלו והתבקש להעביר את הסכום לחשבון של ספק. לאחר שתי שיחות נוספות הבחין המנכ״ל כי המספר ממנו התבצעו השיחות חשוד, וכך התגלתה לבסוף ההונאה – אך המבצעים לא נתפסו עד היום.

בתחילת 2020 נגנבו באופן דומה 35 מיליון דולר מבנק באיחוד האמירויות. גם במקרה זה התבצעה שיחה מלווה במיילים שנשלחו כביכול מלקוח, וגם במקרה זה עדיין לא נלכדו כל האשמים בהונאה.

הונאות מסוג זה מבוססות על קול ואינן מצריכות דיבורים ממושכים של האדם שבקולו משתמש הזיוף העמוק. עקב כך, עסקים גלובליים צריכים להשתמש כעת בטכנולוגיות שונות לזיהוי זיוף עמוק בכדי להגן על עצמם מזליגת נתונים והונאות מסוג זה.

זיוף עמוק זדוני אחר, עושה שימוש באנשים שונים בתכנים פורנוגרפים למטרות סחיטה או השחרת אופי (לדוגמא, הבוט שהופץ באפליקציית אינסטגרם אחראי לבדו לכ-100000 קורבנות, בהם גם קטינות). סרטוני זיוף עמוק פורנוגרפי משמשים להשתקה, הפחדה או ניצול של נשים בעמדות מפתח חברתיות או פוליטיות, וקשה מאוד להלחם בתופעה זו גם במדינות מתוקנות. הקושי נובע מזמינות הטכנולוגיה וממהירות ההפצה ברשתות החברתיות. לרוב לא ניתן לאתר את מקור הסרטונים הללו ולא ניתן לעצור את שיתופם מרגע שעלו לרשתות.

זיוף עמוק זדוני נוסף מכוון להטייה פוליטית, השפעה על דעת קהל וביטחון לאומי. סרטונים שנוצרו למטרה זו מכוונים ליצירת מצג כוזב של דמויות מפתח שונות, והוא סומן כאיום אסטרטגי על ידי אירגוני מודיעין וביטחון שונים בעולם כבר ב-2019.

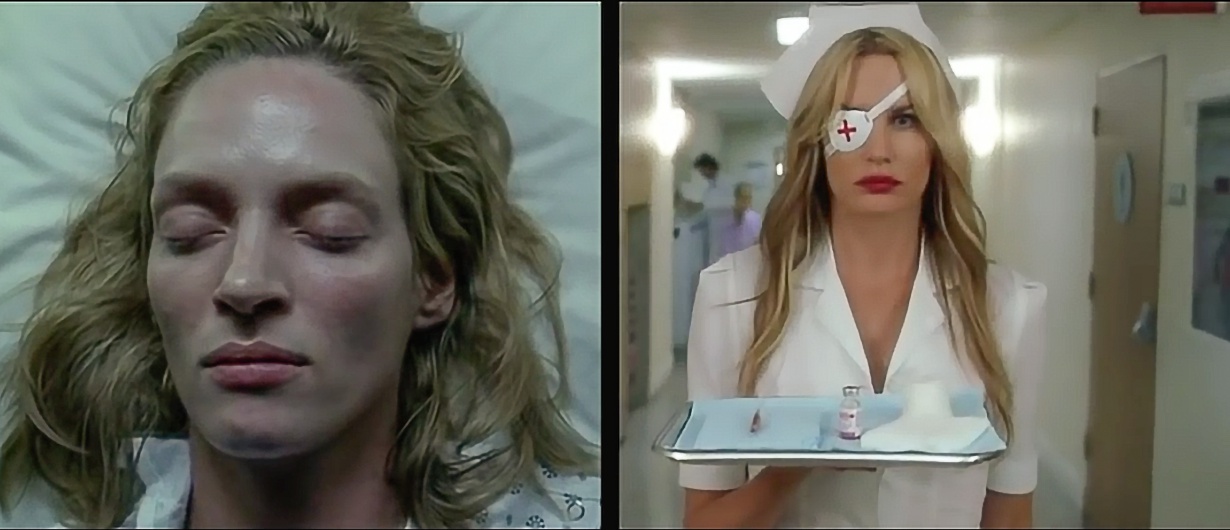

בחרתי להציג דווקא שתי דוגמאות מבדרות העושות שימוש באנשים מפורסמים מאוד בכדי להדגים את הזיוף העמוק ולחשוף אותו לקהל הרחב:

בדוגמא הבאה נשיא ארה״ב לשעבר ברק אובמה ״מדגים״ זיוף עמוק:

דוגמא של ״ברכת חג מולד אלטרנטיבית״ ממלכת אנגליה:

היבטים משפטיים

לצד פיתוחים טכנולוגיים שונים לזיהוי תכנים שנוצרו בטכנולוגיית זיוף עמוק, נעשים מאמצים של רשויות שונות בעולם ברמה המשפטית. האתגרים המשפטים נובעים ממהירות התפשטות התכנים האלה ברשתות החברתיות השונות בעולם, עובדה המקשה על איתור יוצרי הסרטונים המקוריים והעמדתם לדין.

בנוסף, כפועל יוצא משימוש בכלים אלה, קשה מאוד לזהות באיזה כלי נוצר הסרטון ולצמצם חשודים בהפקתו. נגישותם של כלים אלה גבוהה, ולרוב אין צורך בכח עיבוד יוצא דופן, או באיש מקצוע רציני ליצירתו – עובדה המקשה על איתור חשודים.

אתגר נוסף הוא בעובדה שפרסום סרטונים ברשתות חברתיות מוגן במרבית העולם על ידי חופש הביטוי, ולפיכך גם במקרה של לכידת חשוד בהעלאת תוכן שכזה, סיכוי רב יותר להרשעתו יתמקד בהוצאת דיבה, לשון רע, וגרימת פגיעה מכוונת באדם אחר. לתביעות על בסיס הפרת זכויות יוצרים, זכויות פרסום ופרטיות סיכויים נמוכים מאוד להגיע להרשעה.

בעיה נוספת היא שיתכן והיוצר של הסרטון אינו מתגורר במקום בו הופץ הסרטון ולפיכך אינו כפוף למערכת החוק שם.

בשנים האחרונות נוצרו חוקים המגדירים מחדש שימוש זדוני בטכנולוגיית זיוף עמוק למטרת הונאות שונות כפלילי. כך למשל כבר ב-2019, נוצרו חוקים במדינות שונות בארה״ב שהגדירו שימוש בזיוף עמוק לשם הטיית תוצאות בחירות כעבירה פלילית. אך במרבית העולם עד כה הטכנולוגיה מקדימה את החוק בטיפול במקרים של זיוף עמוק זדוני, ועדיין אין מענה חוקי שמגדיר שימוש שכזה כפלילי, בעיקר במקרים של הונאה, פורנוגרפיה וניצול לרעה.

אפילו בסין, שהגדירה שימוש בטכנולוגית זיוף עמוק, או אירוח של תכנים כאלה ללא סימון, כעבירה פלילית, לא מוגדר מהו העונש למי שעובר על חוק זה.

אסכם שבכל העולם (וגם אצלנו כמובן) נדרשת חקיקה ורגולציה למניעת הפצת זיוף עמוק זדוני ולשם מתן כלים לרשויות השונות להתמודדות ותגובה עם מקרים כאלה.

כיצד לזהות ״זיוף עמוק״

זיהוי זיוף עמוק תלוי באיכותו של הזיוף. ברמה הפשוטה סרטונים ״מטופלים״ כאלה מציגים מספר אלמנטים שניתן להבחין בהם ללא כלים מורכבים של זיהוי:

- חוסר אחידות – לעיתים רבות חלקים מהדמות המטופלת בסרטון יראו לא מותאמים מבחינת צבעוניות פה ושם במהלך הסרטון. יתכן גם שחלקים שונים יראו ״רכים״ או מטושטשים לסירוגין.

- היבהובים ובעיות איכות שונות – לעיתים ניתן יהיה להבחין בריצודים והיבהובים שונים של הדמות תוך כדי תנועה או דיבור.

- סאונד מוזר או לא טבעי – פעמים רבות ניתן דווקא לזהות בסאונד משהו מכני ולא טבעי.

- אזור פנים הפה מטושטש – המנועים שעושים שימוש בעיוות שפתיים כדי לדמות תנועות דיבור, מטשטשים את פנים הפה של הדובר פעמים רבות.

- בעיות התאמה של אור וצל – במקומות מסויימים בסרטון יש בעיות רגעיות של הצללה על פניו וגופו של הדובר.

שילוב של סימנים אלה ונוספים עשוי לרמוז שמדובר בתוכן של זיוף עמוק. החיסרון של זיוף עמוק (כרגע) הוא בפרטים קטנים שקשה לזייפם ושדורשים כח עיבוד רב, לפיכך לרוב מדובר בתוכן קצר יחסית שניתן לזהות בו פרטים חשודים שונים. בנוסף, מובן שמומלץ להפעיל שיקול דעת ולבדוק מה מקור הסרטון והאם הוא נראה אמין. ההמלצה היא לצפות שוב ושוב בסרטון החשוד ולהתמקד באזור השפתיים, העיניים, המצח והצוואר. באזורים אלה נוכל לזהות את הזיוף פעמים רבות.

בדוגמא הבאה נשיא אוקראינה זלנסקי קורא לכוחותיו להכנע. הדוגמא הוצגה בעולם לאחר שזוהתה כזיוף עמוק בכדי להדגים כמה פשוט לתעתע בצופה, אך ניתן להבחין בה במספר סימנים מאלה שציינתי לעיל:

ככל שהטכנולוגיה מתקדמת קשה יותר להבחין בזיוף עמוק ללא כלים טכנולוגיים מתקדמים, וקשה לעבור על כמות החומר הדרושה בכדי לנתח זאת. לפיכך מפותחים כיום גם כלי אימות מתקדמים יותר שיעזרו בזיהוי.

כלי אימות מתקדמים

קיימים בשוק כלים שונים להשוואת חתימות קול וזיהוי פנים מתקדם. כלים אלה עושים שימוש בהשוואת גלי קול, ניתוח תווי פנים או זיהוי אזורים מטושטשים, אך יש להם מגבלות ולכן לעיתים אינם מזהים זיוף עמוק.

החל ב-2020 משתמשת מיקרוסופט בכלי לזיהוי דפוסי קבצים שנוצרו על ידי בינה מלאכותית (שמו microsoft video authenticator – מאמת הוידאו).

גם פייסבוק יצרה יישום לזיהוי של קבצי זיוף עמוק כבר ב-2021, אך דיוק הזיהוי שלו עדיין עומד על 65%-70 כרגע.

ai.sensity ההולנדי, מתמקד בזיהוי פנים שזויפו, אך עדיין אינו מזהה חפצים שנערכו לתוך קובצי זיוף עמוק.

חברת האבטחה Zemana השיקה כלי לשימוש הציבור בשם Deepware המאפשר לזרוק סרטונים חשודים לאתר ולזהות אם מדובר בזיוף עמוק. לאחרונה הם גם השיקו כלי כזה למשתמשי אנדרואיד שניתן להורדה למכשיר הנייד.

יש להניח שכלי אימות אלה יהפכו מתוחכמים יותר ככל שיתרבו שימושים זדוניים בטכנולוגיה.

לסיכום, זיוף עמוק יכול להיות מיושם למטרות חיוביות ומועילות במגוון דרכים שוודאי עדיין לא נוצלו עד הסוף. אך כמו כל טכנולוגיה אחרת – הוא מאפשר גם שימושים זדוניים ולפיכך יש ללמוד איך לזהות אותו ולחנך אוכלוסיות שונות להזהר ממנו כשהוא בהקשרים מסוימים.

לאור המודעות לסיכונים שבו, יש לקוות שתתבצע חקיקה ורגולציה של שימוש בטכנולוגיה הזו במקביל לפיתוח יישומים מדוייקים יותר לזיהוי תכני זיוף עמוק.

אסיים באימרה של סוקרטס שמתאימה למאמר זה: ״התובנה האמיתית היחידה היא לדעת שאתה לא יודע כלום״ 🙂